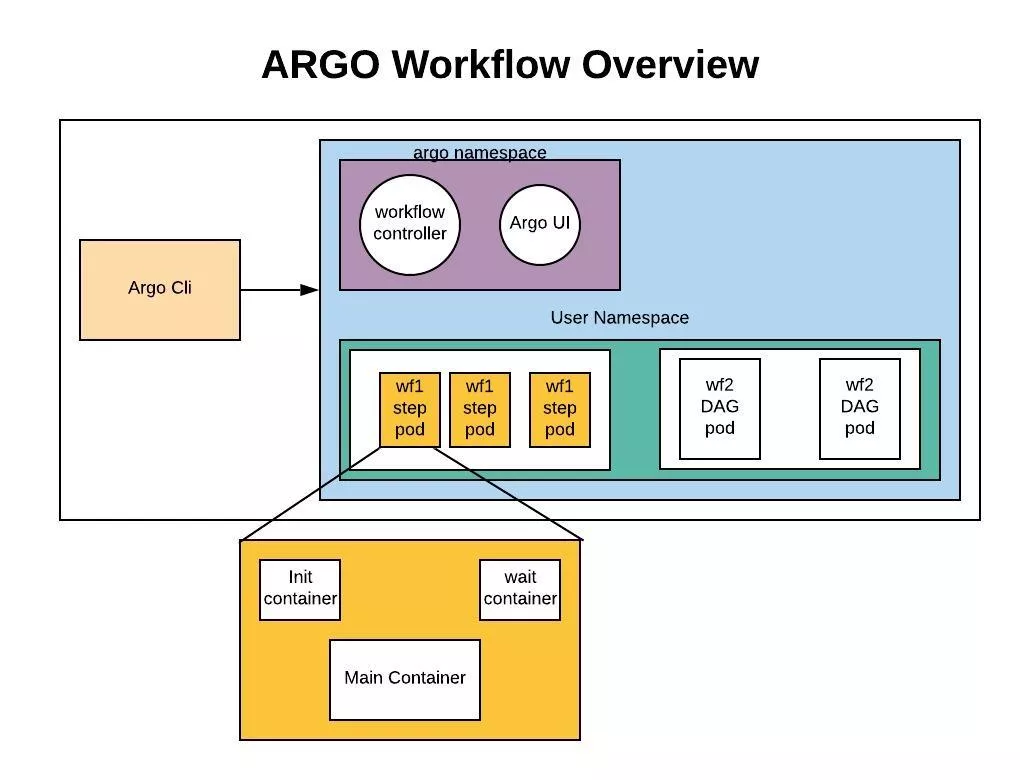

Argo是一个基于Kubernetes的开源容器化工作负载管理平台。它旨在简化DevOps流程,并减少运营部署和管理Kubernetes环境时的复杂性。

Argo工作流

Argo工作流是用于建模、编排和执行一组相关任务的工作流程。它使用YAML文件来定义工作流的各个阶段和任务。Argo工作流具有多个特性,例如:

支持多种任务类型,包括容器化任务、脚本任务、并行任务等;

提供不同类型的控制流,例如串行、并行、条件、循环等;

支持与外部工具和服务进行交互,例如Git、Jenkins、Slack等;

提供丰富的日志和指标支持,以便于排查和监控工作流。

以下是一个简单的Argo工作流示例:

apiVersion: argoproj.io/v1alpha1

kind: Workflow

metadata:

name: example

spec:

entrypoint: hello

templates:

- name: hello

container:

image: busybox

command: [echo, "Hello, Argo!"]在该示例中,我们定义了一个名为example的工作流,它包含一个名为hello的模板,模板使用busybox容器来打印一条消息。当我们提交该工作流后,Argo会创建一个Kubernetes Job以运行该任务。

Argo CD

Argo CD是一个连续交付工具,用于自动化应用程序部署到Kubernetes集群。它提供了一种基于GitOps的应用程序部署方式,将应用程序配置存储在Git存储库中,并根据Git存储库中的最新版本自动更新和部署应用程序。Argo CD提供了以下特性:

提供可视化的UI和CLI工具,简化配置和管理;

与Git存储库进行集成,支持GitHub、GitLab、Bitbucket等;

支持多种应用程序配置格式,包括Helm Chart、Kustomize、Kubernetes Manifest等;

提供根据指标和Web钩子事件来升级和回滚应用程序的自动化功能。

以下是一个简单的Argo CD应用程序示例:

apiVersion: argoproj.io/v1alpha1

kind: Application

metadata:

name: example

spec:

source:

repoURL: 'https://github.com/example/example.git'

targetRevision: 'master'

path: 'kubernetes'

destination:

server: 'https://kubernetes.default.svc'

namespace: 'example'

syncPolicy:

automated:

prune: true

selfHeal: true在该示例中,我们定义了一个名为example的应用程序,它从GitHub存储库的kubernetes目录中获取应用程序配置。当我们更新存储库中的应用程序配置时,Argo CD会自动将新版本部署到目标Kubernetes集群中。

Argo事件

Argo事件是用于在Kubernetes集群中管理事件和告警的工具。它通过收集Kubernetes API服务器的事件和告警,将其转换为易于管理的格式,并通过多种方式进行通知,例如Slack、MS Teams、PagerDuty等。Argo事件提供以下特性:

支持多种事件源,例如Kubernetes事件、Prometheus告警等;

支持根据事件源、标签等条件过滤和筛选事件;

提供灵活的通知方式,例如电子邮件、短信、即时消息等。

以下是一个简单的Argo事件示例:

apiVersion: argoproj.io/v1alpha1

kind: EventSource

metadata:

name: kubernetes

spec:

kind: KubernetesEvent

version: v1.15.0

source:

apiServer: https://kubernetes.default.svc

namespace: default

dependency:

labels:

app: example

filter:

type: Normal

webhook:

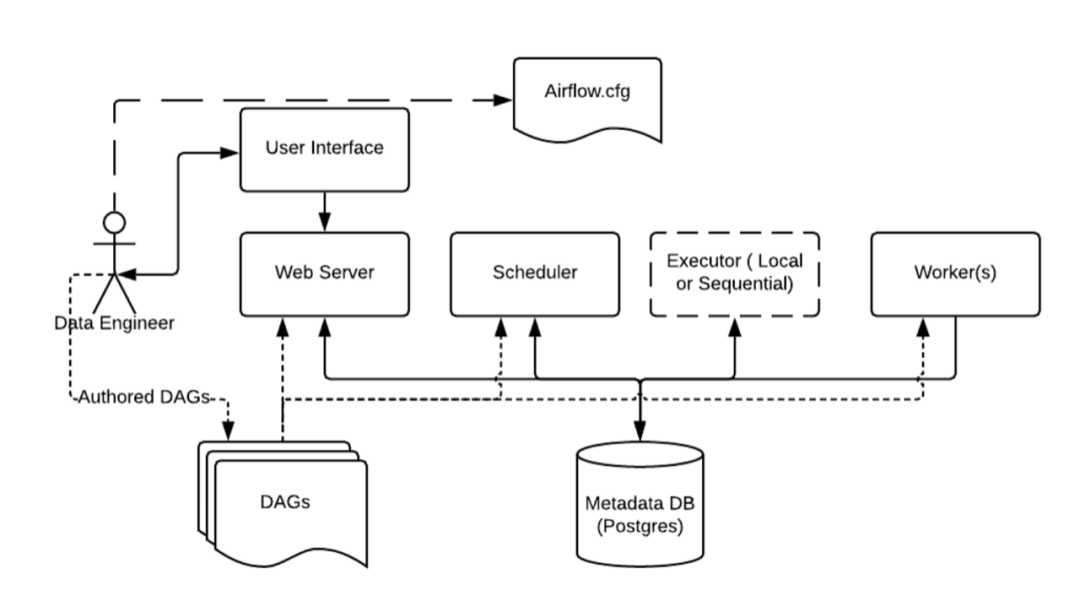

url: https://example.com/webhookAirflow是一个开源的基于Python的工作流管理工具,它可以帮助用户轻松地调度和编排任务。本文将介绍Airflow的主要特性和用例,以及如何使用它来构建复杂的数据处理工作流程。

Airflow的特性

基于DAG的编程模型

Airflow采用基于DAG的编程模型,从而可以将复杂的工作流程划分为多个独立的任务节点,并且可以按照依赖关系依次执行。DAG节点可以使用Python编写,从而使得Airflow支持广泛的任务类型和数据源。

可视化的工作流程

Airflow内置了一个可视化的UI界面,可以方便地查看和管理工作流程的状态。用户可以在UI界面中查看任务运行情况、查看日志和统计信息。

丰富的任务调度功能

Airflow支持多种任务调度方式,如定时触发、事件触发和手动触发等。用户可以自定义任务的调度规则,以适应不同的场景。

强大的插件机制

Airflow的插件机制允许用户通过编写自定义插件来扩展其功能。插件可以添加新的任务类型、数据源和调度器等,从而实现更加灵活的工作流程。

Airflow的用例

数据移动和转换

Airflow可以用来编排数据移动和转换的过程,以便将数据从一个系统或数据源传输到另一个系统或数据源。

ETL工作流程

Airflow可以用于构建ETL(抽取、转换和加载)工作流程,从而让数据工程师能够处理大量复杂的数据集。

机器学习任务

Airflow可以用来编排机器学习任务,如数据清洗、特征提取和模型训练等。

使用Airflow构建工作流程

Airflow的主要构建块是DAG,开发Airflow任务需要以下几个步骤:

安装Airflow

用户可以使用pip命令来安装Airflow,安装后可以使用命令“airflow initdb”初始化Airflow环境。

创建DAG

用户可以通过编写Python代码来创建DAG,包括定义任务、设置任务之间的依赖关系和设置任务调度规则等。

运行Airflow任务

一旦DAG被定义和设置好,用户可以通过Airflow的命令行工具来启动任务,并且可以在UI界面中查看任务状态、日志和统计信息等。

总之,Airflow作为一款强大的工作流管理工具,能够帮助用户处理复杂的数据工作流,从而实现数据处理的自动化和追溯性。

Argo和Airflow是两个流行的开源工作流调度平台,它们都提供了可视化的界面以及强大的任务调度和管理功能。下面是它们的比较:

架构和设计

Argo使用Kubernetes作为其基础架构,它使用Kubernetes原生的API对象和CRD进行任务调度和管理。而Airflow是基于Python的分布式任务调度平台,使用Celery、RabbitMQ等开源工具。

编排语言

Argo的编排语言是YAML和JSON格式,这种语言对于工作流的定义比较简单和易懂。Airflow则是使用Python来编写任务和调度逻辑,开发者需要对Python比较熟悉。

可扩展性

由于Argo是基于Kubernetes构建的,因此具有较好的可扩展性,能够方便地适应不同的工作负载和规模。Airflow的扩展性较弱,需要手动进行配置。

可视化界面

Argo提供了Web界面来管理和可视化任务执行的流程,包括检查任务状态和日志文件等。Airflow也提供了命令行和Web UI两种方式来实现任务的管理和可视化。

社区生态

Argo的社区相对较小,但由于它基于Kubernetes而言,它受益于Kubernetes的强大生态系统。Airflow的社区更加活跃,已经成为了一个大型的开源项目,它拥有强大的社区贡献和插件支持。

总之,Argo和Airflow都是优秀的开源工作流调度平台,它们各有优点,可以根据具体要求进行选择。如果您的工作负载需要高度可扩展性和Kubernetes的协作能力,那么Argo是更好的选择;如果您在Python方面拥有较强的技能,并需要丰富的社区支持和插件,那么Airflow则是较好的选择。